La Organización de Naciones Unidas para la Educación, la Ciencia y la Cultura (Unesco) pidió a los gobiernos de todo el mundo regular cuanto antes el uso de la inteligencia artificial generativa (IA) en las escuelas para garantizar su uso ético y centrado en el ser humano.

Y es que tras la masificación desde principios de 2023 del uso de la IA, como el ChatGPT, que genera automáticamente contenido en respuesta a instrucciones escritas, cualquier tarea escolar puede resolverse -bien o mal- en segundos. En lugar de buscar datos en las páginas web existentes, la IA ofrece contenido nuevo. Además de textos, la IA generativa es capaz de crear imágenes, videos, música y códigos de programación informática, por lo que puede tener un profundo impacto en la educación y la investigación.

Estos avances tecnológicos han desatado un debate en todo el mundo. Por ejemplo, la ciudad de Nueva York, en Estados Unidos, prohibió el uso del ChatGPT en las escuelas en enero de este año, pero cuatro meses después, en mayo, reconsideró su decisión. En Panamá, actualmente queda a discreción de los directores de escuelas. No existe una política institucional para su uso.

Lo que dice Unesco

Según la directora general de la Unesco, Audrey Azoulay, la IA generativa puede ser una tremenda oportunidad para el desarrollo humano, pero también puede causar daños.

“No se debe integrar en la educación sin el compromiso público y sin las salvaguardas y regulaciones necesarias por parte de los gobiernos. Estas orientaciones ayudarán a los responsables políticos y a los docentes a aprovechar mejor el potencial de la IA en interés primordial de los educandos”, dijo.

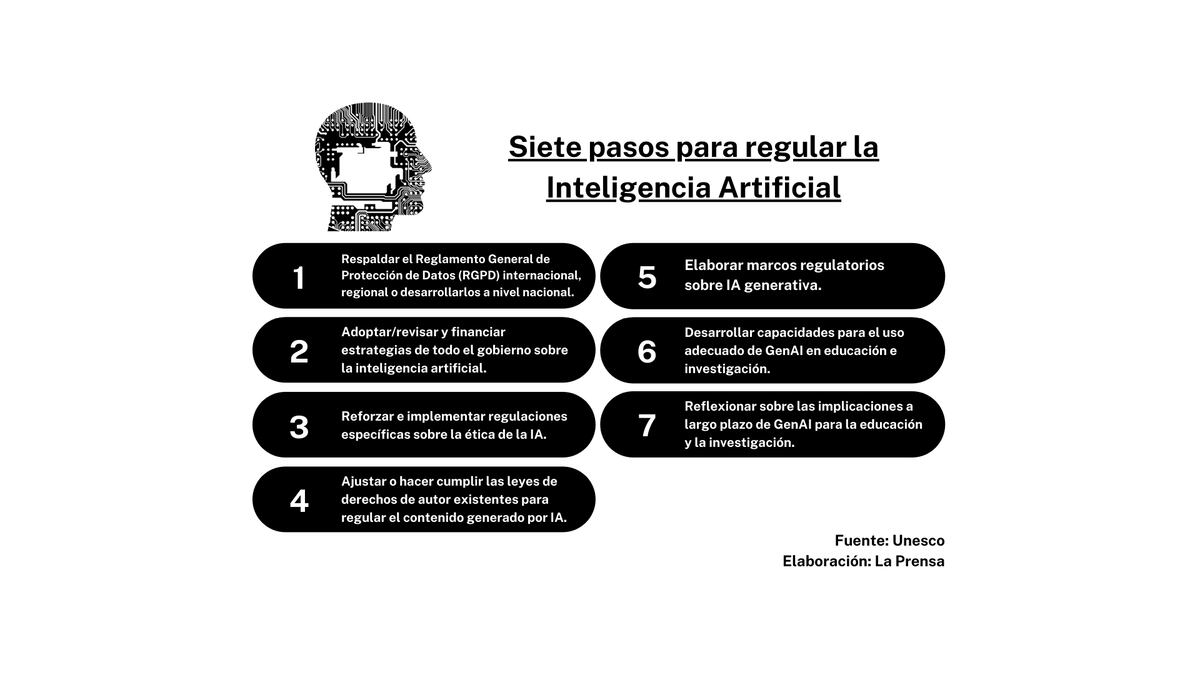

La guía de la Unesco establece siete pasos clave que los gobiernos deberían dar para regular la IA generativa y establecer marcos políticos para su uso ético en la educación y la investigación.

La organización también recalcó que se debe establecer un límite de edad mínima de 13 años para el uso de herramientas de IA en las aulas y aboga por la formación de los profesores en esta materia.

Los siete pasos a seguir son los siguientes:

1. Respaldar el Reglamento General de Protección de Datos (RGPD) internacional, regional o desarrollarlos a nivel nacional.

2. Adoptar/revisar y financiar estrategias de todo el gobierno sobre la IA.

3. Reforzar e implementar regulaciones específicas sobre la ética de la IA.

4. Ajustar o hacer cumplir las leyes de derechos de autor existentes para regular el contenido generado por IA.

5. Elaborar marcos regulatorios sobre IA generativa.

6. Desarrollar capacidades para el uso adecuado de GenAI en educación e investigación.

7. Reflexionar sobre las implicaciones a largo plazo de GenAI para la educación y la investigación.

La Unesco advierte, además, sobre la posibilidad de que aumente la brecha digital entre las economías fuertes, con empresas capaces de generar más datos o innovar, y las más débiles, que a largo plazo quedarían expuestas a ser colonizadas por los estándares incorporados en los modelos de los transformadores generativos preentrenados (GPT, por sus siglas en inglés). El desarrollo de IA también han sido criticado por no permitir que sus sistemas estén sujetos a una rigurosa revisión académica independiente.

Muchos sistemas han sido acusados de violar los derechos de propiedad intelectual, recuerda el informe.

SIP pide respetar derechos de propiedad

Precisamente este es uno de los temas que preocupan a los generadores de contenidos en todo el mundo. Un día antes del pronunciamiento de la Unesco, el pasado 6 de septiembre, la Sociedad Interamericana de Prensa (SIP) , entre 26 organizaciones que representan a miles de profesionales creativos de todo el mundo, incluidas empresas periodísticas, de revistas, editoriales y del sector editorial académico, anunció su respaldo a los Principios Globales para la Inteligencia Artificial (IA).

Las organizaciones exigen el desarrollo y la implementación responsable de sistemas y aplicaciones de IA, afirmando que estas nuevas herramientas sólo deben desarrollarse de acuerdo con los principios y leyes establecidos que protegen la propiedad intelectual, las marcas, las relaciones con los consumidores y las inversiones de los editores.

Este tema, incluso, ha sido objeto de sentencias judiciales. El pasado 20 de agosto, la juez de distrito de Columbia, Estados Unidos, Beryl Howell, confirmó la postura de la Oficina de Derechos de Autor de ese país de que las obras de arte creadas únicamente mediante IA no pueden acogerse a la protección de derechos de autor.

La sentencia de Howell fue una respuesta a la disputa legal de Stephen Thaler contra la negativa del gobierno a registrar las creaciones producidas por IA. Thaler, CEO de Imagination Engines -una empresa de redes neuronales-, sostenía que la IA que cumpliera los criterios de autoría debía ser reconocida como tal.

La realidad en Panamá

Recientemente, se dio a conocer el Índice Latinoamericano de Inteligencia Artificial (ILIA), elaborado por el Centro Nacional de Inteligencia Artificial de Chile, en el que por primera vez evalúan las condiciones que tienen 12 países de la región, entre ellos Panamá, para aprovechar esta tecnología.

El ILIA mide cinco dimensiones: los factores habilitantes para que se desarrolle un sistema de IA robusto en el país; la investigación, desarrollo y adopción de esta tecnología; la gobernanza o marco jurídico y ambiente institucional con el que se cuenta; la percepción que existe en la sociedad en redes sociales y medios digitales, y, por último, las tendencias académicas y visión de los expertos del impacto social.

Panamá ocupó la novena posición entre 12 países, con un puntaje de 24.66 por debajo de la media regional, que es de 42.6 y de la máxima de 100 puntos. Se indica que el país carece de talento con habilidades de IA, no proporciona educación superior en esta área, no tiene un plan estratégico nacional que promueva esta tecnología avanzada y carece de leyes y regulaciones que impulsen la IA.

Al consultar con el Meduca sobre el uso de la IA en las escuelas, se informó que se ha ordenado hacer un estudio para determinar cómo se usaría. Es decir que actualmente no existe una política al respecto.

En la Comisión de Educación, Cultura y Deportes de la Asamblea Nacional reposa un anteproyecto de ley (el 14 del 6 de julio 2023) que pretende regular la IA en diferentes campos, propuesto por el ciudadano Edwin Cepeda. No ha sido prohijado.

En una reciente entrevista con La Prensa, Luis Oliva, administrador de la Autoridad de Innovación Gubernamental, dijo que con el Banco Interamericano de Desarrollo se trabaja en un primer análisis y desarrollo de una estrategia de IA. Eso incluiría la academia, el sector público y privado y podría empezar a aplicarse en 2024.